Die rasante Entwicklung der Künstlichen Intelligenz (KI) hat in den letzten Jahren beeindruckende Fortschritte gebracht und verändert zunehmend unsere Gesellschaft. Von der medizinischen Diagnostik über autonome Fahrzeuge bis hin zu Gesichtserkennung und automatisierten Entscheidungssystemen – KI-Technologien durchdringen immer mehr Bereiche unseres Lebens. Doch mit diesen technologischen Durchbrüchen gehen auch tiefgreifende ethische Fragen einher. Wie können wir sicherstellen, dass KI verantwortungsvoll eingesetzt wird und zum Wohle der Menschheit beiträgt? Dieser Artikel beleuchtet die wichtigsten ethischen Herausforderungen im Bereich der KI und stellt mögliche Lösungsansätze vor.

Die zentralen ethischen Herausforderungen

1. Bias und Diskriminierung

Eine der drängendsten Herausforderungen im Bereich der KI-Ethik ist das Problem von Verzerrungen (Bias) und Diskriminierung in KI-Systemen. KI-Algorithmen lernen aus historischen Daten, die oft gesellschaftliche Vorurteile und Ungleichheiten widerspiegeln. Wenn diese Algorithmen dann für Entscheidungen eingesetzt werden, können sie bestehende Diskriminierungen verstärken oder sogar neue schaffen.

Ein bekanntes Beispiel ist der Fall eines Rekrutierungstools von Amazon, das systematisch Bewerbungen von Frauen abwertete, weil es aus historischen Daten gelernt hatte, in denen Männer in der Tech-Branche überrepräsentiert waren. Ähnliche Probleme wurden bei Algorithmen zur Kreditvergabe, Gesichtserkennung und Risikobewertung im Strafjustizsystem beobachtet.

2. Transparenz und Erklärbarkeit

Viele moderne KI-Systeme, insbesondere komplexe Deep Learning-Modelle, funktionieren als "Black Boxes". Selbst ihre Entwickler können oft nicht genau erklären, wie diese Systeme zu bestimmten Entscheidungen kommen. Diese mangelnde Transparenz und Erklärbarkeit wird zum ethischen Problem, wenn KI-Systeme in kritischen Bereichen eingesetzt werden, wo Entscheidungen tiefgreifende Auswirkungen auf Menschenleben haben können – etwa in der medizinischen Diagnostik, der Strafverfolgung oder bei autonomen Fahrzeugen.

Die Frage, wie viel Transparenz wir von KI-Systemen fordern sollten und wie wir diese erreichen können, ist eine der zentralen Herausforderungen der KI-Ethik.

3. Privatsphäre und Datenschutz

KI-Systeme benötigen enorme Mengen an Daten für ihr Training. Dies wirft Fragen nach dem Schutz der Privatsphäre, der informierten Einwilligung und der Datenhoheit auf. Wie können wir sicherstellen, dass persönliche Daten geschützt werden, während wir gleichzeitig den Fortschritt in der KI-Forschung ermöglichen?

Besonders problematisch sind Technologien wie Gesichtserkennung und Emotionserkennung, die das Potenzial haben, zu allgegenwärtiger Überwachung zu führen und grundlegende Freiheiten zu bedrohen.

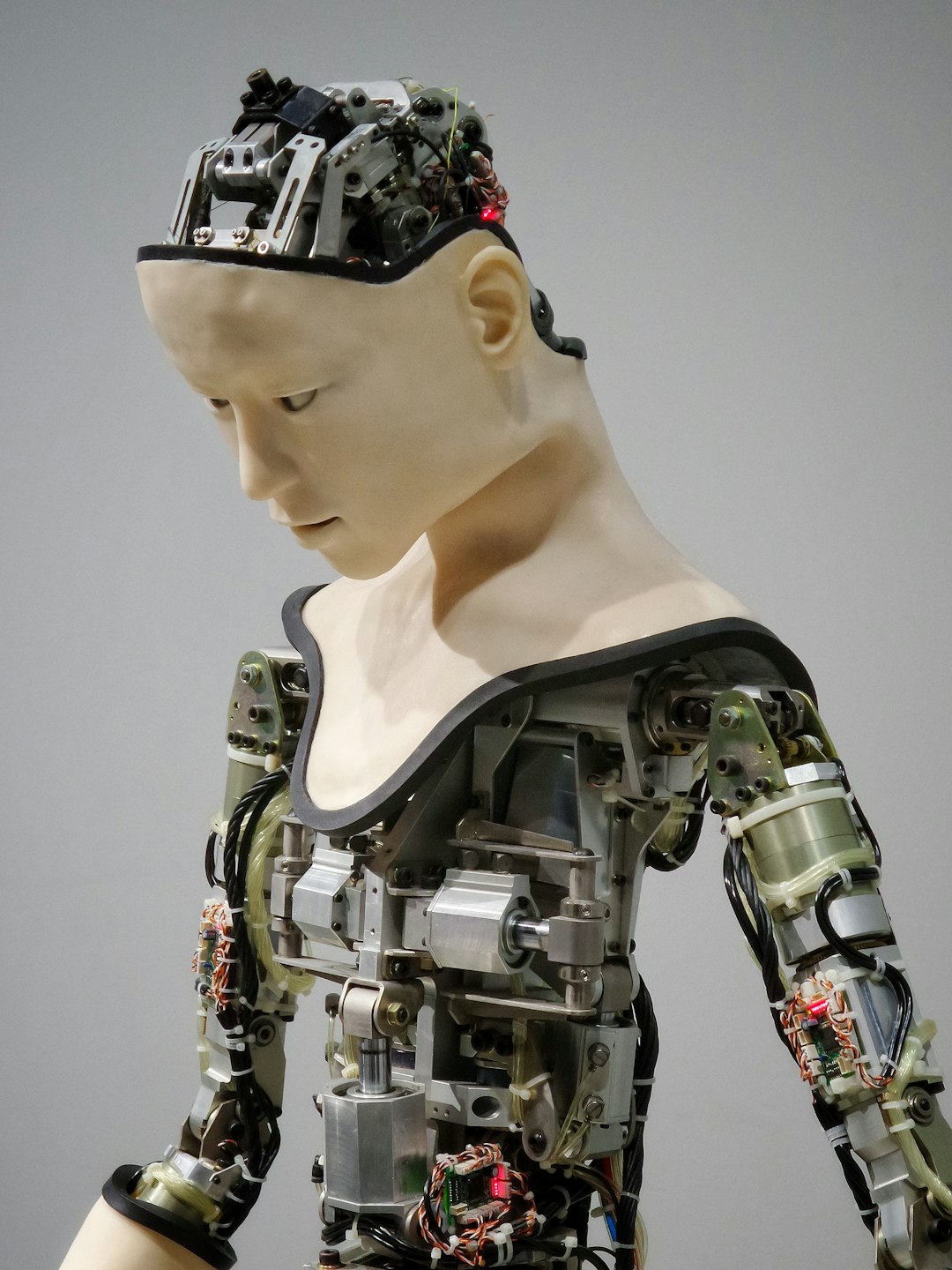

4. Autonomie und menschliche Kontrolle

Mit zunehmender Autonomie von KI-Systemen stellt sich die Frage, wie viel Kontrolle wir an Maschinen abgeben sollten. Wer trägt die Verantwortung, wenn ein autonomes System einen Schaden verursacht? Diese Fragen werden besonders relevant bei autonomen Waffensystemen, selbstfahrenden Autos und KI-Systemen im Gesundheitswesen.

Der Grundsatz der "bedeutsamen menschlichen Kontrolle" (meaningful human control) wird oft als ethischer Leitprinzip angeführt, aber seine praktische Umsetzung bleibt eine Herausforderung.

5. Verteilungsgerechtigkeit und digitale Kluft

Die Vorteile und Risiken von KI-Technologien sind ungleich verteilt. Während einige Bevölkerungsgruppen und Länder stark von KI-getriebenen Innovationen profitieren, bleiben andere zurück oder sind überproportional von negativen Auswirkungen betroffen. Diese "KI-Dividende" verstärkt bestehende sozioökonomische Ungleichheiten.

Zudem besteht die Gefahr einer wachsenden digitalen Kluft zwischen technologisch fortschrittlichen und weniger entwickelten Regionen, sowie zwischen verschiedenen Bevölkerungsgruppen innerhalb von Gesellschaften.

Lösungsansätze für eine ethisch verantwortungsvolle KI

1. Ethische Leitlinien und Prinzipien

In den letzten Jahren haben zahlreiche Organisationen, Unternehmen und Regierungen ethische Leitlinien für KI entwickelt. Diese Prinzipien – wie Fairness, Transparenz, Verantwortlichkeit und Gemeinwohl – bieten einen normativen Rahmen für die Entwicklung und den Einsatz von KI-Systemen.

Beispiele hierfür sind die Ethik-Leitlinien für vertrauenswürdige KI der Europäischen Kommission, die OECD-Prinzipien zu KI und die Asilomar-Prinzipien für KI-Forschung. Diese Leitlinien sind ein wichtiger erster Schritt, müssen jedoch durch konkrete Maßnahmen und verbindliche Regelungen ergänzt werden.

2. Technische Lösungen für ethische Probleme

Die Forschung arbeitet intensiv an technischen Lösungen für ethische Herausforderungen in der KI. Dazu gehören:

- Fairness-Algorithmen: Methoden zur Erkennung und Korrektur von Verzerrungen in KI-Systemen

- Erklärbare KI (XAI): Techniken, die die Entscheidungsprozesse von KI-Systemen transparenter und nachvollziehbarer machen

- Datenschutzfreundliche Techniken: Wie föderiertes Lernen, differenzielle Privatsphäre und homomorphe Verschlüsselung, die es ermöglichen, KI-Systeme zu trainieren, ohne sensible Daten preiszugeben

Diese technischen Ansätze sind vielversprechend, haben aber auch ihre Grenzen. So gibt es oft Trade-offs zwischen verschiedenen ethischen Werten (z.B. zwischen Genauigkeit und Fairness) und zwischen ethischen Anforderungen und technischer Leistungsfähigkeit.

3. Regulierung und Governance

Angesichts der Grenzen freiwilliger Selbstverpflichtungen und technischer Lösungen wird zunehmend über regulatorische Ansätze diskutiert. Die Europäische Union hat mit dem Vorschlag für eine KI-Verordnung einen risikobasierten Regulierungsansatz vorgelegt, der KI-Anwendungen nach ihrem Risikopotenzial klassifiziert und entsprechende Anforderungen stellt.

Weitere Governance-Mechanismen umfassen:

- Ethische Folgenabschätzungen für KI-Systeme

- Zertifizierungssysteme für vertrauenswürdige KI

- Auditverfahren zur Überprüfung von KI-Systemen auf ethische Compliance

- Internationale Koordination und Harmonisierung von KI-Regeln

Die Herausforderung besteht darin, Regulierungen zu entwickeln, die Innovation nicht übermäßig einschränken, aber gleichzeitig wirksamen Schutz vor Schäden bieten.

4. Partizipative Entwicklung und Bildung

Eine ethisch verantwortungsvolle KI erfordert die Beteiligung verschiedener Stakeholder und die Berücksichtigung unterschiedlicher Perspektiven. Partizipative Ansätze in der KI-Entwicklung können dazu beitragen, dass KI-Systeme die Bedürfnisse und Werte unterschiedlicher Gemeinschaften berücksichtigen.

Gleichzeitig ist es wichtig, das öffentliche Verständnis von KI zu fördern und kritische digitale Kompetenzen zu vermitteln. Nur so können Bürgerinnen und Bürger informierte Entscheidungen über den Einsatz von KI treffen und an gesellschaftlichen Debatten teilnehmen.

5. Interdisziplinäre Forschung und Zusammenarbeit

Die ethischen Herausforderungen der KI sind komplex und erfordern eine interdisziplinäre Herangehensweise. Technische Expertise muss mit Erkenntnissen aus Philosophie, Recht, Soziologie, Psychologie und anderen Disziplinen verknüpft werden.

Forschungsinitiativen wie das "Trustworthy AI" Programm der EU oder das "Partnership on AI" in den USA bringen verschiedene Akteure zusammen, um gemeinsam an Lösungen für ethische Probleme zu arbeiten.

Fallbeispiele: Ethische Dilemmata in der Praxis

Das autonome Fahrzeug-Dilemma

Autonome Fahrzeuge müssen in Gefahrensituationen blitzschnell Entscheidungen treffen, die ethische Dilemmata beinhalten können: Wenn ein Unfall unvermeidbar ist, soll das Fahrzeug eher die Insassen oder externe Personen schützen? Wie sollen Risiken zwischen verschiedenen Verkehrsteilnehmern abgewogen werden?

Diese Fragen verdeutlichen die Schwierigkeit, ethische Prinzipien in algorithmische Entscheidungen zu übersetzen. Der deutsche Ethik-Beirat für autonomes Fahren hat hierzu Leitlinien entwickelt, die unter anderem besagen, dass eine Abwägung nach persönlichen Merkmalen (Alter, Geschlecht etc.) unzulässig ist.

KI in der Medizin: Chancen und Risiken

KI-Systeme zeigen beeindruckende Erfolge in der medizinischen Diagnostik, etwa bei der Erkennung von Hautkrebs oder der Analyse von Röntgenbildern. Doch ihr Einsatz wirft auch ethische Fragen auf: Wie kann die Entscheidungshoheit von Ärzten gewahrt bleiben? Wie gehen wir mit Fehldiagnosen um? Wie verhindern wir, dass KI-Systeme bestehende Gesundheitsungleichheiten verstärken?

Eine mögliche Lösung liegt in "Mensch-Maschine-Teams", bei denen KI als Unterstützungssystem für medizinische Fachkräfte dient, aber nicht autonom entscheidet.

Zukunftsperspektiven: Auf dem Weg zu einer menschenzentrierten KI

Die Entwicklung ethischer KI ist kein einmaliges Projekt, sondern ein kontinuierlicher Prozess. Mit dem technologischen Fortschritt werden auch neue ethische Fragen aufkommen, die kreative Lösungen erfordern.

Langfristig geht es darum, eine menschenzentrierte KI zu entwickeln – also Technologien, die menschliche Werte, Rechte und Bedürfnisse in den Mittelpunkt stellen und als Werkzeuge zur Förderung menschlichen Gedeihens dienen.

Dies erfordert nicht nur technische Innovation, sondern auch gesellschaftlichen Dialog, politischen Willen und internationale Zusammenarbeit. Die Frage, wie wir die Vorteile der KI nutzen und gleichzeitig ihre Risiken minimieren können, gehört zu den wichtigsten Herausforderungen unserer Zeit.

Fazit

Die ethischen Herausforderungen der Künstlichen Intelligenz sind vielfältig und komplex. Sie reichen von konkreten Problemen wie Bias und mangelnder Transparenz bis hin zu grundlegenden Fragen über das Verhältnis zwischen Mensch und Maschine.

Es gibt keine einfachen Lösungen für diese Probleme, sondern nur multidimensionale Ansätze, die technische, regulatorische, bildungspolitische und gesellschaftliche Maßnahmen kombinieren. Der Weg zu einer ethisch verantwortungsvollen KI erfordert kontinuierliche Reflexion, offene Debatten und die Bereitschaft, aus Fehlern zu lernen.

Die gute Nachricht ist: Das Bewusstsein für die ethischen Dimensionen der KI wächst, und immer mehr Akteure engagieren sich für eine verantwortungsvolle Entwicklung dieser Technologien. Wenn wir es richtig machen, kann KI zu einem mächtigen Werkzeug werden, um einige der drängendsten Probleme der Menschheit zu lösen und eine gerechtere, nachhaltigere und wohlhabendere Zukunft zu gestalten.

Kommentare (4)

Laura Meyer

2. November 2023, 09:41Ein sehr wichtiger Artikel zu einem Thema, das oft übersehen wird! Als Informatikstudentin frage ich mich oft, wie wir Ethik besser in die technische Ausbildung integrieren können. In meinem Studium kommen ethische Fragen kaum vor, obwohl wir die Entwickler der Zukunft sind.

Dr. Michael Hoffmann

3. November 2023, 14:22Ich arbeite selbst in der KI-Entwicklung und kann bestätigen, dass das Thema Bias ein enormes Problem darstellt. Wir versuchen zwar, unsere Trainingsdaten zu diversifizieren, aber es ist unglaublich schwierig, alle potenziellen Verzerrungen zu erkennen und zu beseitigen. Regulierung ist hier definitiv notwendig, aber sie muss praxisnah sein und mit der schnellen Entwicklung Schritt halten können.

Jana Schröder

4. November 2023, 10:05Ich finde die Diskussion um ethische KI wichtig, aber manchmal auch etwas einseitig. Wir fokussieren uns oft auf die Risiken und übersehen dabei die enormen Chancen, die KI für die Lösung globaler Probleme bietet - vom Klimawandel bis zur Bekämpfung von Krankheiten. Eine ausgewogene Betrachtung ist wichtig.

Prof. Dr. Sabine König

5. November 2023, 16:37Ausgezeichneter Artikel, der die Komplexität des Themas sehr gut erfasst. Ich möchte noch einen Aspekt ergänzen: Die kulturelle Dimension von KI-Ethik. Ethische Werte und Prioritäten variieren zwischen verschiedenen Kulturen, und wir müssen darauf achten, nicht eine westlich geprägte Ethik-Konzeption global durchzusetzen. Internationale Zusammenarbeit muss verschiedene Perspektiven berücksichtigen.

Hinterlassen Sie einen Kommentar